一、语义分割与实例分割

语义分割:为每个像素分配类别标签,同类多个物体不区分实例。实例分割在检测基础上为每个实例生成 mask(如 Mask R-CNN)。

输出与输入同分辨率(或上采样回原尺寸);标签常用 one-hot 或类别索引,可视化用 argmax 得 mask。

二、评价指标

对类别 $c$,交并比 $\mathrm{IoU}_c=\frac{|P_c\cap G_c|}{|P_c\cup G_c|}$,mIoU 为各类 IoU 的平均。

mAcc:像素级分类正确率平均,易偏高(大类主导),故 mIoU 更常用。

三、编码器—解码器与上采样

分类网络通过池化/步长卷积降低分辨率、增大感受野,但丢失空间细节。分割需恢复分辨率:编码器提取语义,解码器逐步上采样。

上采样方式:最近邻/双线性插值;转置卷积(可学习,需注意 kernel 与 stride 配置以避免棋盘格伪影);反池化(如记录 max 池化索引的 unpooling)。

▸转置卷积与棋盘格

当 kernel 尺寸不能被 stride 整除时,输出可能出现周期性强弱分布。实践中可改用 resize + 普通卷积,或选用不会重叠的配置。

四、空洞(扩张)卷积

- 在卷积核元素间插空,扩大感受野而不增加核参数、不降低分辨率,弥补去掉池化后的感受野不足;ASPP 用多分支不同空洞率并行,捕获多尺度上下文。

五、代表性方法(简述)

- FCN:将全连接改为 $1\times 1$ 卷积,输出低分辨率类激活图,再双线性上采样;可融合浅层细节(如 FCN-8s 跳连)。

SegNet:编码器 max-pooling 时保存最大索引,解码器用 反池化 上采样,参数较少。

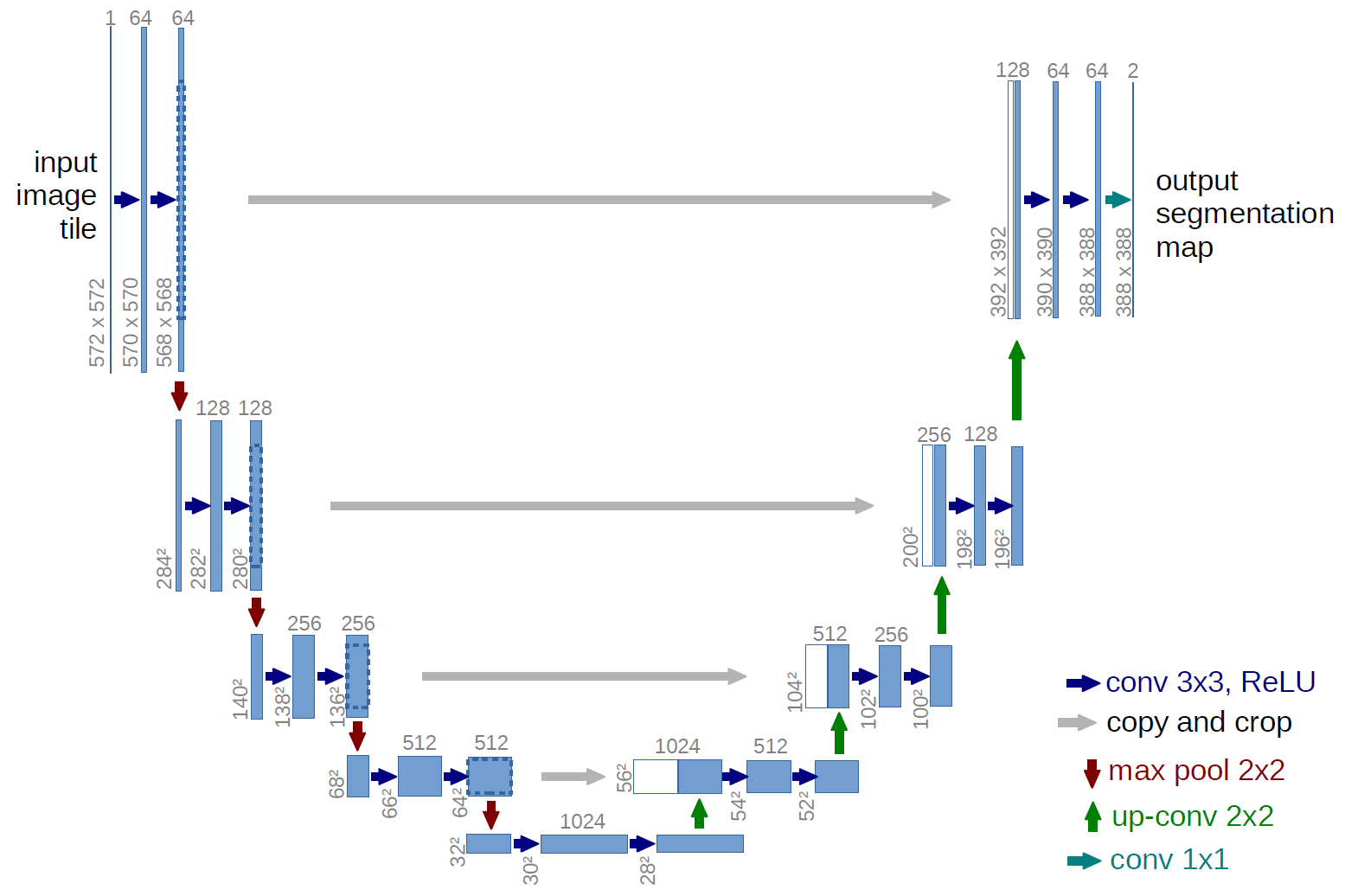

U-Net:对称 U 形,编码器与解码器同尺度特征 concat 跳连,医学小样本场景常用。

- PSPNet:金字塔池化模块聚合多尺度全局上下文。

- DeepLab 系列:空洞卷积 + CRF 后处理(早期)$\rightarrow$ ASPP + 图像级特征(V3)$\rightarrow$ 编码器用 ResNet / Xception,逐步弱化 CRF;DeepLabV3+ 引入轻量解码器细化边界。

六、池化与分割的矛盾

- 池化带来平移鲁棒性但损失定位信息;解法包括:少用池化改用空洞卷积、解码器融合多尺度特征、边界监督或专用 refine 模块。

七、与检测、全景分割的关系

- 全景分割统一语义与实例任务;现代工作多用 Transformer 或统一 query 架构,本笔记不展开。

八、推导与掌握要点(增补)

- mIoU 与像素准确率

对类别 $c$,$P_c$ 为预测为该类的像素集合,$G_c$ 为真值。$\mathrm{IoU}_c=|P_c\cap G_c|/|P_c\cup G_c|$。若分母为 0(某类未出现),实现上常忽略或记特殊值。mIoU $=\frac{1}{C}\sum_c \mathrm{IoU}_c$(或仅在出现类上平均)。像素准确率 $\mathrm{PA}=\sum_c |P_c\cap G_c|/\sum_c|G_c|$,大类主导明显;mIoU 对类间平衡更敏感。

▸并集与交集的计数关系

$|P_c\cup G_c|=|P_c|+|G_c|-|P_c\cap G_c|$,故 IoU 完全由正确预测数与预测/真值总数决定,实现时常用混淆矩阵逐类统计。

- 带孔卷积的有效核与步长

一维上,核大小 $k$,空洞率 $r$,相邻权重间距为 $r$,则有效覆盖长度为 $(k-1)r+1$。二维 separable 时,若横向纵向空洞率均为 $r$,则 $k\times k$ 核的有效「足迹」约为 $[(k-1)r+1]^2$。堆叠多层空洞卷积可指数级扩大感受野而不降低分辨率,但可能出现 gridding(网格伪影),故 ASPP 用多分支不同 $r$ 并行。

- FCN 跳连融合的向量形式

设最后一层粗预测上采样后与浅层同尺寸特征分别为 $\mathbf{U}_l,\mathbf{F}_s$(通道可对齐),FCN 常用逐元素相加或拼接再 $1\times 1$ 卷积融合:$\mathbf{H}=\phi(\mathbf{U}_l+\mathcal{P}(\mathbf{F}_s))$,其中 $\mathcal{P}$ 为对浅层可能需要的 $1\times 1$ 降维。FCN-8s 逐级融合 conv3、conv4、score 层,使边界更锐利。

- 转置卷积输出尺寸(与卷积对偶)

若将转置卷积视为「分数步长卷积」,输出空间尺寸常满足(与步长 $S$、padding $P$、核 $F$、输入 $W$ 相关)

$$W_{\mathrm{out}}=(W-1)S-2P+F.$$

具体与框架「padding 语义」有关,调参出现棋盘格时优先检查 $F$ 与 $S$ 是否整除关系,或改用 双线性上采样 + 卷积。

- 语义分割损失

逐像素 softmax 交叉熵(可对难例、边界加权);或 focal 变体减轻易分像素主导。类不平衡时常用 class weight $\propto 1/\mathrm{freq}_c$ 或 median frequency balancing。

- DeepLab ASPP 的多分支意义

并行空洞率 $r\in{6,12,18}$(示例)捕获不同尺度上下文,再加图像级全局池化分支,拼接后经 $1\times 1$ 融合,等价于「多尺度卷积核」且共享主干参数效率高。

九、逻辑脉络(如何把前面几节串起来)

主线:语义分割 = 逐像素分类 $\rightarrow$ 分类网天然降采样,分割需 恢复分辨率(解码器、上采样、跳连)$\rightarrow$ 纯池化丢定位,故用 空洞卷积 / ASPP 扩大感受野少下采样 $\rightarrow$ FCN / U-Net / DeepLab 代表三条常见路线:全卷积 + 跳连、对称 U 形、空洞 + 金字塔上下文。读论文时对照:输入输出分辨率、是否用 CRF 后处理、ASPP 分支数。

与 CV4/CV6:分割编码器常与 ImageNet 预训练 CNN 共享头部思想;实例分割在 检测框或 ROI 上再掩膜(Mask R-CNN),语义分割则 不区分数个同类实例。

十、分步例题(便于自检)

▸例1:两类单像素的 mIoU(与第二节、第八节一致)

设仅背景类 0、前景类 1,一张图 3 个像素。真值标签全为 1(全是前景),预测为 $[1,1,0]$。则类 1:$|P_1\cap G_1|=2$,$|P_1|=2$,$|G_1|=3$,$|P_1\cup G_1|=2+3-2=3$,$\mathrm{IoU}_1=2/3$。类 0:预测与真值在该类上交集为 0,分母为 $|P_0\cup G_0|$,通常 IoU 为 0(或依实现忽略空类)。mIoU 为各类 IoU 的平均,可见 漏检前景像素 会拉低 IoU。

▸例2:空洞一维有效长度(与第八节 2 对照)

一维核大小 $k=3$,空洞率 $r=2$,相邻非零权重间距为 2,则覆盖的输入位置跨度为 $(k-1)r+1=(2)\times 2+1=5$,即等价于在一条线上「看到」5 个输入位置的线性组合,而 不增加 可训练标量个数(仍 3 个权重)。二维 $3\times 3$ 空洞卷积在 $r=2$ 时,有效足迹约为 $5\times 5$,但仍是 9 个参数(与标准 $3\times 3$ 相同)。

▸例3:双线性上采样 + $1\times 1$ 卷积(与第三节、第八节 4 对照)

若转置卷积出现棋盘格,可改为:先把低分辨率特征 双线性插值 到目标尺寸,再接 普通卷积 混合通道与细化边界。这是工程上最稳妥的替换之一,代价是多一次卷积计算。